La Inteligencia Artificial ya no es una promesa futura; es una realidad que influye en decisiones cotidianas, modelos de negocio, políticas públicas y procesos educativos. Sin embargo, su crecimiento exponencial ha abierto una pregunta fundamental: ¿quién vigila a los algoritmos?

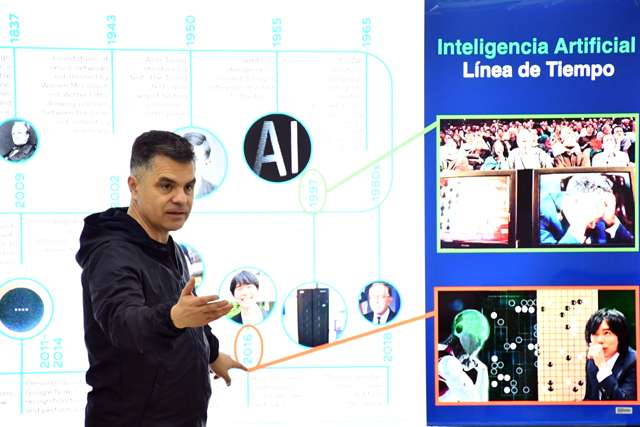

Con la master class “Ética Algorítmica”, impartida en el Complejo Cultural Universitario, la BUAP colocó en el centro del debate un tema que trasciende lo tecnológico: la responsabilidad social del diseño y uso de sistemas inteligentes.

El Mtro. Marcelo García Almaguer, especialista en IA y responsable de la Agencia Especializada en Inteligencia Artificial de la universidad, explicó que nos encontramos en un punto de inflexión histórico. A diferencia de las herramientas tradicionales, la IA genera conocimiento sin reproducir el proceso cognitivo humano. No “piensa” como las personas; opera mediante modelos matemáticos y probabilísticos que pueden producir resultados sin una lógica transparente para el usuario.

Este cambio plantea desafíos profundos. Si un algoritmo decide a quién otorgar un crédito, qué currículum filtrar o qué información mostrar, ¿cómo se garantiza que no reproduzca sesgos sociales preexistentes? ¿Quién asume la responsabilidad cuando un sistema automatizado discrimina o se equivoca?

Durante la sesión se subrayó la necesidad de regulación. El desarrollo tecnológico avanza a una velocidad que supera los marcos legales actuales, lo que puede derivar en vacíos normativos y riesgos sociales. La transparencia algorítmica —es decir, la posibilidad de comprender cómo y por qué un sistema toma decisiones— se convierte en un principio indispensable.

Pero la discusión no se limita a normas jurídicas. También implica formación ética. La conciencia sobre el uso responsable de la IA debe permear en desarrolladores, instituciones, empresas y usuarios.

La creación, en enero de 2026, de la Agencia Especializada en Inteligencia Artificial de la BUAP representa un paso estratégico en esa dirección. Más allá de la innovación técnica, el reto es consolidar un modelo de desarrollo tecnológico orientado al bien común.

En un contexto global donde la Inteligencia Artificial redefine industrias completas, el debate ya no es si debemos usarla, sino cómo hacerlo sin sacrificar derechos, equidad y responsabilidad social. La ética algorítmica deja de ser un concepto académico para convertirse en una necesidad urgente.